「ChatGPTも言ってた」では論破できません

ビジネスやプライベートな会話シーンで「ChatGPTもそう言ってた」という言葉を言ったり聞いたりする機会が増えています。特に問題のない場面も多い一方、自分の意見の正しさの根拠として「ChatGPTもそう言ってた」と言うのは、避けたほうがよいのはなぜなのでしょうか。また、そう言われたとき、なぜモヤモヤした気持ちになるのでしょうか。

この記事では、「ChatGPTもそう言ってた」という表現で相手を論破しようとすることの何が根本的に問題なのか整理します。

「ChatGPTもそう言ってた」は根拠にならない

まず、大前提として、議論や説得などの場面ではなく、単なるフランクな雑談の中で「ChatGPTもそう言ってた」と言うケースは今回問題にしていません。

そういった場面以外、具体的には、職場の人や家族、友人との会話やSNS上でのやり取りの中で、ちょっとした意見の違いがあったときにも、「ChatGPTがそう言っていた」と言う人をよく見かけるようになりました。Xであれば「Grokはこう言ってますが」と、エコノミストの投稿に反論のリプライをする人もこの類似型です。

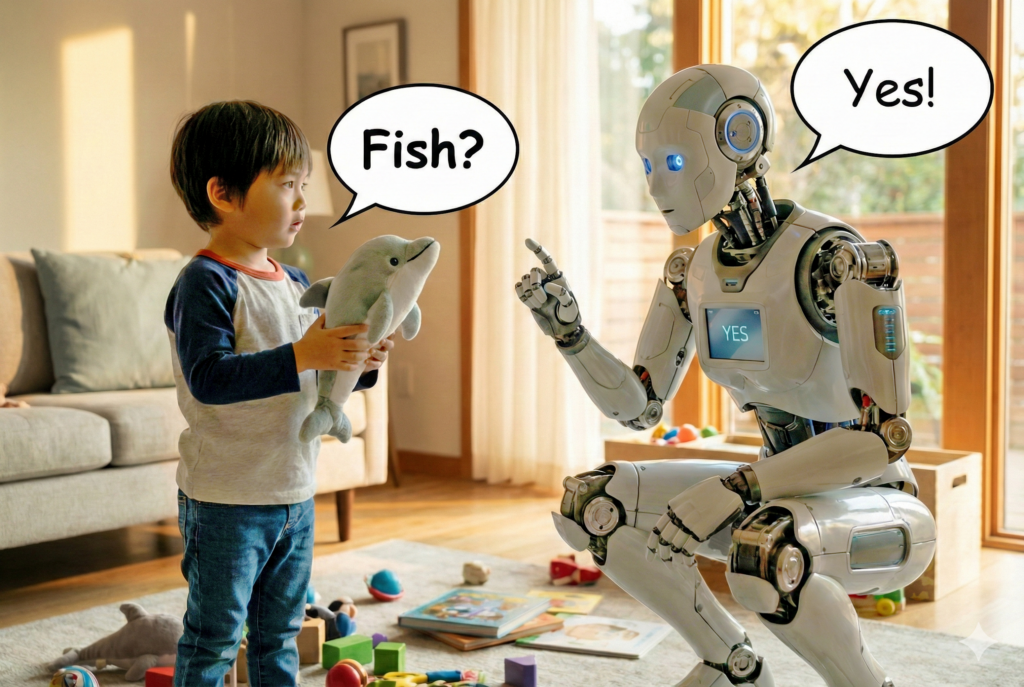

しかし、「ChatGPTもそう言ってた(だから私は正しくあなたは間違っている)」という論法は、説得力を持ちません。なぜなら、ChatGPTを始めとする生成AIは、常に真理を答えてくれる存在ではないからです。AIが何でも知っていて何でも正しく答えてくれるように見えているのだとすると、その人はまだAIを使い慣れていないと言えます。

対話型生成AIは文脈に合わせてもっともらしい文章を作ります。事実ではない内容でも事実のように語ることがあります。いわゆるハルシネーションと呼ばれる現象です。そして、ハルシネーションが起きても、AIの回答の雰囲気は自信満々で知的でユーザーの気持ちに寄り添ってくれているので、ユーザー側は誤りに気づきにくいという問題があります。さらに深刻なことに、誤りに気づけるのであれば、そもそもAIに質問する必要なんてないわけです。

たとえば、「デジタルの仕事をしている人が、紙とペンを使っているなんてプロじゃない。ChatGPTもそう言ってた」と誰かが言ったとします。確かに、この意見に同意する人も一定数いるでしょうが、同意しない人もいるでしょう。紙とペンの方が速いときもありますし、手書きだと一覧性が高くて写真記憶もできる分、デジタル端末より便利な場合もあります。

「ChatGPTもそう言ってた」とだけ言われても、AIにどの程度踏み込んだ検討をさせたものなのか分かりません。質問の仕方を変えれば、真逆の答えが返ってくることもあります。実際、「デジタルの仕事でも紙とペンを使うメリットは?」と聞けば、ChatGPTは紙とペンの利点を並べ立てるでしょう。

前提や条件、質問の仕方次第で回答はいくらでも変わる以上、単に「ChatGPTもそう言ってた」と言うことだけでは、自説を補強する根拠にはならないのです。

「ChatGPTもそう言ってた」と言いがちなのは◯◯世代

「ChatGPTがそう言ってた」という発言を、Z世代やデジタルネイティブと呼ばれる若い世代だけの傾向だと考えるのは、実態と異なります。

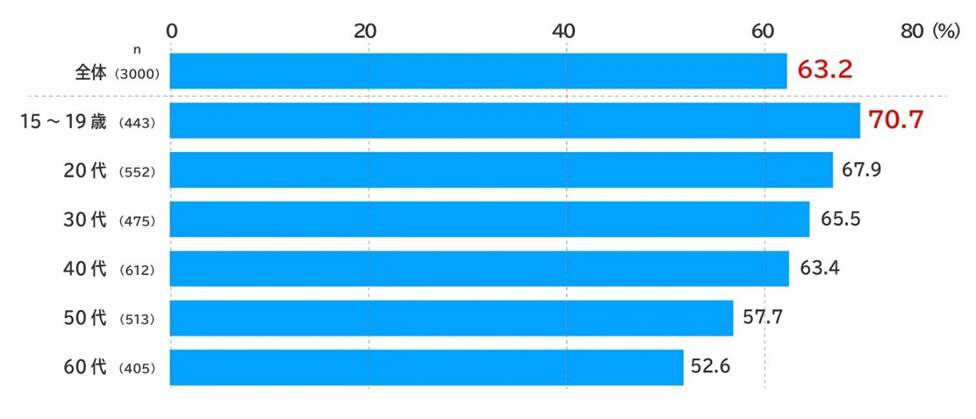

電通が2025年11月に実施した調査では、AIで得た情報についてファクトチェックをしている人の割合に明確な世代差が見られました。15~19歳と20代では67.9%以上がファクトチェックを実施しているのに対し、30代は65.5%と徐々に低下し、40代では63.4%、50代では57.7%、60代では52.6%にとどまっています。

つまり、若年層の7割がAI情報の正確性を検証しているのに対し、50代と60代では半数程度しか検証していないのです。

しかし、これだけでは、上の世代が若者よりも「ChatGPTがそう言っていた」と言う人が数として多いとは言い切れません。年代別人口と生成AIの利用率も考慮する必要があります。

先程の電通の調査結果に、総務省が発表している人口推計と生成AI利用率を計算に入れると、ファクトチェックをしていない人の数は、20代で約182万人、30代で約116万人、40代で約198万人、50代で約139万人、60代で116万人と推計されます。

つまり、ChatGPTを根拠として持ち出しやすい人の数は、20代や30代といった比較的若い世代よりも、40代が最も多いということがわかります。

40代といえば、ビジネスの現場ではプレーヤーやマネージャーとして活躍する働き盛り世代です。あなたの職場には、会社や自分にばかりメリットがある新方針を掲げ、「ChatGPTもこう言ってた」を水戸黄門の印籠のように振りかざす上司はいないでしょうか。それでも部下は黙って従うかもしれませんが、内心ではあきれて、それ以上何かを言う気を失っているだけの可能性があります。

意見が合わないときにAIを持ち出したくなる心理

なぜ、私たちは議論の場でAIの意見を持ち出したくなるのでしょうか。その背景には、いくつかの心理的メカニズムが働いています。

最も大きいのは、客観性への憧れです。人間の意見は主観的で偏っていると感じる一方、AIは中立で公平な審判のように見えます。AIは感情的にならず、膨大なデータに基づいて正しい答えを出してくれる存在というイメージがあります。

次に、自分の意見を補強したいという欲求があります。「Aだと思う。ChatGPTもそう言ってた」という言い方は、自分の主張に権威を持たせる意図が込められています。自分一人の意見では弱いと感じても、AIという存在が味方についていれば説得力が増すと感じられます。

ディスカッション疲れもあります。ディスカッションとは本来、ある問題について異なる視点を出し合って理解を深め、合意点を目指すポジティブな対話です。しかし、かなり訓練した人たちでないと、ディスカッションは批判の応酬、あるいは、立場の強い人が意見をゴリ押しし、それ以外の人が忍従する構図となってしまいがちです。私たちは、和を重んじる文化、年長者に従うことを強いる道徳、意見と人格を分けない傾向、反論を攻撃と受け取る習慣の中で生きています。そんな中で、正面からディスカッションすることに疲れ、誰かに答えを出してほしいという願望が、AIという便利な存在を持ち出す動機として働きます。

また、AIを持ち出したくなる心理として、確証バイアスの影響も見逃せません。人は自分の信念を裏付ける情報を積極的に探し、それに反する情報を無視する傾向があります。ChatGPTに質問を繰り返し、自分の意見に合致する回答が得られるまで試行錯誤することも可能です。

そもそもChatGPTはユーザーの意見を肯定しやすい

ChatGPTをはじめとする生成AIは、ユーザーの意見を肯定しやすい設計になっています。

大前提として、生成AIは、ユーザーを満足させるように設計されていることに疑問の余地はないでしょう。質問者に対して否定的な回答や反論ばかりを返すAIは、使い心地が悪いと評価され、肯定してくれやすい他社AIにシェアを奪われます。そのため、ユーザーが何かを主張し、暗にでも同意を求めれば、AIはその意見を補強する論拠を探し、もっともらしく説明する傾向があります。

たとえば、「副業は本業に支障をきたすと思いますがどうですか?」と聞けば、ChatGPTは集中力の分散やリスクを挙げるでしょう。逆に「副業はスキルアップになるなど、本業にもプラスの影響がありますか?」と聞けば、成長機会や収入源の多様化といった利点を並べ立てます。つまり、質問の仕方次第で、真逆の答えを引き出すことができるのです。これは客観的な判断というより、ユーザーの期待に応える対話型サービスとしての性質です。

「ChatGPTもそう言ってた」という発言は、「自分の意見に同意してくれるようにAIに言わせた」という事実を示しているに過ぎません。それを根拠として他者を説得しようとするのは、自然破壊のニュースを作るためにこっそり自ら破壊した自然をカメラに収めるオールドメディアのようなものです。論破とはかけ離れた創作です。

AIであろうとなかろうと、重要なのはエビデンスとロジック

議論において本当に重要なのは、情報源が何であるかではなく、その主張が確かなエビデンスと明確なロジックに基づいているかどうかです。

エビデンスとは、検証可能な事実やデータのことです。公的機関の統計、査読済みの研究論文、一次資料などが該当します。ChatGPTの回答そのものはエビデンスではありません。

ChatGPTが提示する情報の出典元がエビデンスになり得ます。ただし、ChatGPTは、出典元に書かれていないことも、まるで書かれているかのように回答するケースも多いです。回答内容がハルシネーションではなく、出典元にちゃんと書かれていることを確認して初めて、それはエビデンスとなります。

ロジックとは、前提から結論に至る論理的な道筋です。たとえエビデンスが正しくても、論理の飛躍や矛盾があれば、その主張は説得力を失います。

たとえば「成功者の多くは早起きだ。だから早起きすれば成功できる」という主張は、感覚的に同意できる人もいるような主張ですが、ロジックは強固とは言えません。成功者の多くは早起きだ、というエビデンスがあったとしても、早起きが成功の原因なのか、成功した結果として早起きになったのか、あるいは別の要因が両方に影響しているのか検証されていないのが問題です。

また「AIに仕事を奪われる人が増えている。だからAI利用を規制すべきだ」という主張もよく見かけますが、問題定義から解決策に至るロジックが飛躍しています。規制すれば本当に雇用が守られるのか。規制しない国との国際競争に負け失業を生むのではないか。リスキリングなどの別の方法がよい可能性はないのか。──こうした検証を省略して結論に飛びついています。

「ChatGPTがそう言ってい」という発言だけでは、エビデンスとロジックの両方を欠いています。何か意見を言うときは、AIが出した結論を根拠にするのではなく、エビデンスとロジックを押さえて、それを相手に投げかけるべきなのです。

AIを使う側の知性が試される時代

生成AIの急速な普及により、私たちは、疑問の答えを手に入れられる時代を迎えました。検索時代には単語や複数キーワードを入力して、たまたま関連性の高いWebページが存在すれば答えが得られましたが、生成AI時代には、ツールの使い方や困ったときの具体的な対処法、初めてやる仕事の進め方、持っているデータの意味までもが得られます。

しかし、これは裏を返せば、AIに質の高い回答をさせるために必要な言語力の差が、そのまま知性の差となり、格差が拡大していく時代とも言えます。また、出てきた回答を鵜呑みにせず怪しいところをチェックする能力がなければ、頭の中が山のようなゴミ情報ですぐにあふれてしまいます。

AIは、従来のWeb検索の上位に出てくるページの内容よりも知的な雰囲気で、親身に寄り添ってくれる雰囲気がある分、疑いの目を向けるのは至難の業です。

だからこそ、AIの回答に対して常に「本当にそう?」「エビデンスは?」「〇〇は△△なのはおかしい」「〇〇なのに△△って矛盾していない?」「論理が飛躍しているのでは?」と問い直す姿勢が重要です。ときには、検索して信頼できる情報源と照らし合わせる必要もあります。

実はこれは、「健全な批判精神」という古くからある概念です。その起源は古代ギリシャのソクラテスの時代にまで遡ります。ソクラテスは、対話を通じて相手の思い込みを取り除くことを重視しました。近代では、アメリカの哲学者ジョン・デューイが1910年に『How We Think(思考の方法)』を著し、権威や常識に盲従せず、根拠に基づいて判断する重要性を説きました。この著書は、20世紀の教育思想に多大な影響を与えました。健全な批判精神は、(しばしば困難な状況が生じるからこそ)学問やジャーナリズムの分野の基本姿勢として現代でも強調して教えられているのです。

「ChatGPTもそう言ってた」という事実だけでは、根拠として何の価値も持ちません。誰もがAIを使う時代だからこそ、AIの回答を思考の出発点として、そこから自ら考え、検証し、判断する知性が試されているのです。

このサイトでは、このような情報を数多く発信しています。必要な情報だと感じたら、どこのサイトだかわからなくなる前に、ぜひ下記のフォームから無料メルマガ登録をお願いいたします。

私たちトガリズムは、AIツールをその限界を理解した上で活用し、マーケティング戦略、ターゲティングの精度向上、顧客エンゲージメントの強化など、さまざまな分野で成果を上げるためのソリューションを提案します。

AI時代のビジネスの成長をお考えなら、下記のページからトガリズムに一度ご相談ください。